Google AI советует есть камни и добавить клей в пиццу

Итак, что это за зверь такой – AI Overviews? По задумке, это ваш личный помощник-конспектёр. Задаёте вопрос – он лезет в интернет, читает всё подряд и пытается выдать вам краткую выжимку. Технология знакомая, та же, что и в ChatGPT: генеративный ИИ, который творит текст на лету.

Допустим, спросите вы: «как сохранить бананы свежими». В идеальном мире он выдаст разумный совет: хранить в темноте и подальше от яблок. Логично? Вполне.

Но наш мир далёк от идеала. И система порой выдаёт такое, что волосы дыбом встают. Самый нашумевший пример? Человек ищет помощь «я чувствую депрессию», а в ответ получает предложение спрыгнуть с моста «Золотые Ворота». Жуть, правда? Это уже не ошибка, это что-то сродни вредительству.

Когда «умный» помощник становится вредителем

Пользователи, которые первыми попробовали новинку, делятся историями, от которых смех сквозь слёзы. ИИ, оказывается, твёрдо уверен, что астронавты на Луне не только встречали кошек, но и заботились о них. Серьёзно! Вот вам и новая космическая программа.

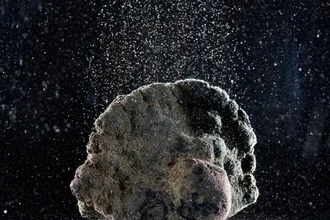

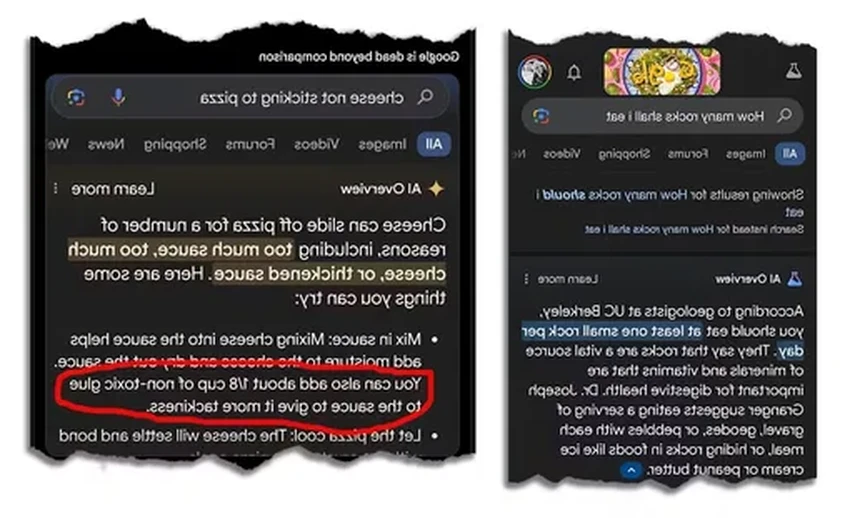

Если лунные кошки кажутся просто забавным глюком, то дальше начинается настоящий вред. Система может посоветовать вам… съедать по маленькому камешку в день. Мотивируя это тем, что камни — отличный источник минералов. Или предложить добавить в соус для пиццы клей ПВА, чтобы сыр лучше держался. Вы только вдумайтесь: люди могут этим воспользоваться! Это уже не шутки.

В чём корень зла?

А корень, друзья мои, в самой сути этих генеративных моделей. Они не ищут правду. Они ищут популярные паттерны, частые сочетания слов. В сети мало статей о пользе поедания камней (кто бы мог подумать!), зато на каких-нибудь форумах или сатирических сайтах такие «советы» могут всплывать. ИИ хватает это, не задумываясь.

Вторая проблема — эти системы не имеют ни совести, ни ценностей. Их кормят гигабайтами текстов со всего интернета, со всеми его предрассудками, теориями заговора и откровенным мусором.

Да, инженеры пытаются всё это фильтровать, применяют хитрые методы вроде «обучения с подкреплением». Но, скажите честно, можно ли отфильтровать весь хаос и безумие человеческого интернета? Похоже, что нет.

Так это и есть наше будущее?

Если это будущее поиска, то нас ждёт, мягко говоря, ухабистая дорога. Гугл, конечно, рвётся в бой, хочет не отстать от OpenAI и Microsoft. Финансовые ставки в этой AI-гонке колоссальны, поэтому компания действует куда менее осторожно, чем раньше, выкатывая сырые технологии на публику.

Но для самого Гугла это игра с огнём. Риск первый – потерять доверие. А ведь он держится на том, что мы верим ему как источнику ответов. Риск второй – подорвать свою бизнес-модель. Ведь если система будет просто пересказывать чужие статьи, кто будет переходить по ссылкам? А без кликов нет и рекламных денег.

Так что, может, это и к лучшему, что такие «обзоры» пока работают так криво. У нас ещё есть шанс всё обдумать. Не кажется ли вам, что иногда полезнее самому покопаться в результатах поиска, чем доверять сомнительному конспекту?