Sora: как генерация видео из текста изменит науку и общество

Вышел Sora — и исследовательское сообщество вздохнуло неоднозначно. В прошлом месяце OpenAI показала миру нечто впечатляющее: несколько коротких текстовых запросов — и на выходе получаешь фотореалистичный видеоклип. Компания даже опубликовала наглядные примеры: вот, смотрите, женщина идет по неоновым улицам Токио. Почти как в кино.

Трейси Харвуд, изучающая цифровую культуру в Университете Де Монфор, признается: она «шокирована» скоростью, с которой развивается эта технология. Помните, как год назад все смеялись над ИИ-роликом, где Уилл Смит ел спагетти? Теперь это не смешно. Некоторые эксперты опасаются, что такие инструменты способны встряхнуть мировую политику уже в 2024 году. Прогресс не остановить, но куда он нас заведет?

OpenAI, родительница ChatGPT и DALL-E, представила Sora 15 февраля. Компания сразу заявила, что даст доступ «красным командам» — специальным группам, которые будут искать уязвимости, тестировать вредоносное использование (те же дипфейки или разжигание ненависти). Результаты их работы мы вряд ли увидим, но OpenAI надеется, что это поможет оценить риски. Честно говоря, звучит как разумная мера предосторожности.

Sora, конечно, не первопроходец. Были и другие: Gen-2 от Runway, выпущенный в прошлом году, и Lumiere от Google, анонсированный в январе. Конкуренция набирает обороты.

Но Харвуд многие разработки не впечатлили. «Они становятся всё примитивнее в том, что выдают», — говорит она. Чтобы получить что-то стоящее, нужны очень точные, выверенные подсказки. Искусство формулировать запросы для ИИ само по себе превращается в сложную дисциплину.

И здесь возникает главная головная боль: дезинформация. «Мы очень быстро окажемся в ситуации, когда нас захлестнет поток вполне убедительной лжи, — предупреждает Харвуд. — Это действительно страшно».

Выборы под прицелом

Особенно остро проблема встаёт на фоне грядущих выборов — президентских в США в ноябре и в парламент Великобритании. «Мы увидим колоссальный вал фейковых видео и аудиозаписей», — прогнозирует Доминик Лис из Университета Рединга, изучающий генеративный ИИ и кинематограф. Мы уже видели прецеденты: поддельная аудиозапись британского оппозиционного лидера Кира Стармера в октябре 2023-го и фейковое обращение Джо Байдена к демократам в январе. Это только начало.

Одно из предлагаемых решений — обязательные водяные знаки. Видимые на видео или спрятанные в метаданных. Но Лис сомневается в их эффективности: «Водяные знаки на видео можно удалить», — поясняет он. А чтобы проверить метаданные, пользователь должен проявить сознательность. «Не думаю, что есть смысл просить каждого человека в мире делать это с каждым просмотренным роликом. Большинству просто всё равно».

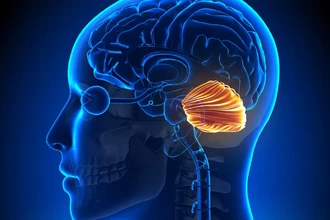

Впрочем, у технологии есть и светлая сторона. Харвуд видит потенциал в образовании: Sora могла бы превращать сухие научные статьи в наглядные ролики. «Одна из ключевых целей — донести сложные научные результаты до широкой аудитории. Технология «текст-в-видео» может визуализировать даже очень абстрактные концепции».

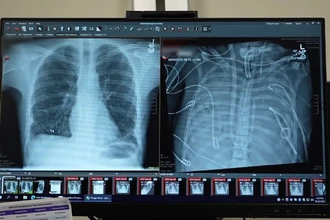

Другое возможное применение — здравоохранение. ИИ-ассистент, общающийся с пациентами вместо врача. «Кого-то это смутит, — говорит консультант по научным коммуникациям Клэр Мэлоун. — Но другим будет удобно: можно задавать одни и те же вопросы хоть сто раз на дню».

Данные под контролем

Такие инструменты, как Sora, могут стать палочкой-выручалочкой для ученых, которые тонут в океане данных. Возьмём, к примеру, ЦЕРН с его гигантскими массивами информации. Работать с ними невероятно сложно. Генеративный ИИ, по словам Мэлоун, способен «тщательно анализировать код и брать на себя рутинные исследовательские задачи». Освобождая человеческий мозг для действительно прорывных идей.

Творческие индустрии, конечно, в панике. Том Хэнкс как-то пошутил, что ИИ позволит ему сниматься в фильмах вечно. «А теперь представьте, что вы молодой амбициозный актер, — говорит Доминик Лис. — И вам говорят: «Извини, но главные роли всегда будет играть цифровой Том Хэнкс». Вам понравится такое будущее?»

Технология «текст-в-видео» ставит перед обществом сложнейшие вопросы. «Нам придётся научиться критически оценивать контент так, как мы никогда раньше не делали, — резюмирует Харвуд. — Но эти же инструменты дают каждому шанс стать творцом. Мы будем разбираться с последствиями. Это фундаментальный сдвиг во всей медиасфере, и пути назад нет».