Теория Колмогорова и Арнольда: новая революционная архитектура нейросетей

Современные нейросети, вдохновленные работой мозга, — это сердце всего, от чат-ботов до генераторов картинок. Но они остаются черными ящиками: миллионы нейронов принимают решения по загадочным для нас причинам. Разве это не смущает? Ученые задались простым вопросом: а можно ли создать что-то столь же мощное, но прозрачное и не такое прожорливое? Оказывается, можно.

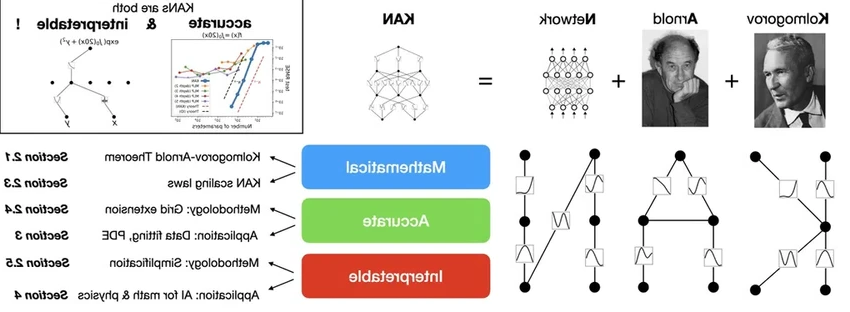

Исследователи разработали принципиально новую архитектуру, которая в некоторых аспектах даже превосходит традиционные системы. Ее сторонники утверждают: эти сети не только более интерпретируемы, но и точнее, даже имея гораздо меньше параметров. Разработчики надеются, что способ, которым новые сети представляют физические данные, поможет ученым открывать новые законы природы. Представьте: нейросеть как помощник в научных открытиях!

Последнее десятилетие инженеры в основном шли путем проб и ошибок, совершенствуя существующие конструкции, — отмечает физик Брис Менар из Университета Джонса Хопкинса. Он не участвовал в работе, но высоко оценил препринт. «Здорово видеть на столе совершенно новую архитектуру», — говорит он, особенно ту, что создана с чистого листа.

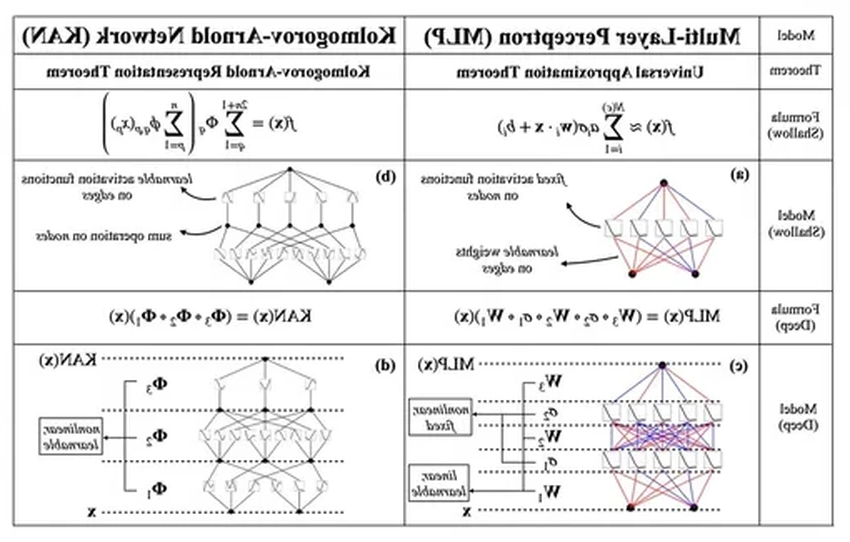

Давайте представим нейросеть как набор узлов (нейронов) и связей между ними (синапсов). В привычных многослойных персептронах у каждого синапса есть «вес» — число, определяющее силу связи. Сигнал проходит от слоя к слою, каждый нейрон что-то суммирует, что-то преобразует стандартной функцией и передает дальше. Процесс мощный, но непрозрачный.

В новой архитектуре синапсы играют куда более умную роль. Они не просто умножают сигнал на число. Каждый синапс обучается представлять полную природу связи между нейронами — целую функцию, преобразующую вход в выход. Эта функция может быть сложной, составной. А нейроны, наоборот, становятся проще: они лишь суммируют то, что им передали синапсы. Смещение акцента, не правда ли?

Новые сети назвали сетями Колмогорова-Арнольда (KAN) в честь математиков, доказавших, что любую сложную функцию можно разложить на комбинацию простых. Идея в том, что KAN обеспечивают гибкость в обучении, используя при этом меньше настраиваемых параметров. Красота математической теоремы нашла свое прикладное воплощение.

Как работает KAN-архитектура

Исследователи протестировали KAN на относительно простых, но показательных научных задачах. Например, брали известные физические законы (скажем, о скорости релятивистских объектов), генерировали по ним данные, а потом скармливали эти данные сети. Оказалось, что увеличение размера KAN улучшает ее производительность гораздо быстрее, чем у традиционных сетей. В решении дифференциальных уравнений KAN оказался в 100 раз точнее, имея при этом в 100 раз меньше параметров. Это не просто улучшение, это качественный скачок.

В другом эксперименте сети предсказывали свойства математических узлов. Традиционная сеть с 300 тысячами параметров показала точность 78%. KAN, имея всего около 200 параметров, достиг точности в 81,6%. Эффективность, граничащая с магией.

Но самое волшебное — это прозрачность. Исследователи могли визуализировать структуру KAN, рассматривать формы функций на каждом синапсе. Они могли вручную упрощать сеть, обрезая слабые связи и заменяя сложные функции на синусы или экспоненты. В итоге всю сеть можно было свернуть в понятную математическую формулу, которая идеально воспроизводила исходный физический закон. Представьте, что вы можете «прооперировать» мозг нейросети и понять ее логику.

«В будущем это может стать повседневным инструментом для ученых, — говорит Цзымин Лю, соавтор работы из MIT. — Если у нас есть неинтерпретируемый набор данных, мы просто пропустим его через KAN, и он сгенерирует гипотезы. Мы сможем заглянуть в этот «мозг» и даже провести на нем операцию».

«Это как инопланетная жизнь, которая смотрит на вещи с другой точки зрения, но при этом понятна людям», — добавляет он. Разве это не то, чего нам всегда не хватало в отношениях с технологиями?

Статья о KAN вызвала бурную реакцию. «Архитектура показалась мне захватывающей в тот же момент, когда я ее увидел», — признается Александр Боднер из Университета Сан-Андрес. Его команда за неделю объединила KAN со сверточными сетями (CNN) для обработки изображений. Их гибрид распознавал рукописные цифры и предметы одежды с точностью, сравнимой с традиционными CNN, но использовал на 60% меньше параметров. Другие группы начали экспериментировать с сочетанием KAN и трансформеров — архитектуры для языковых моделей.

Есть и недостаток: KAN обучаются медленнее на каждый параметр, отчасти потому, что плохо используют графические процессоры. Но им этих параметров нужно меньше. Как отмечает Лю, для многих физических задач, где не требуются гигантские модели, это не станет проблемой.

Ученые уже думают, как эксперты смогут встраивать свои знания в KAN — например, вручную задавая функции активации — и легко извлекать новые инсайты. Возможно, однажды такие сети помогут открыть высокотемпературные сверхпроводники или найти ключ к управляемому термоядерному синтезу. Мечта? Пожалуй. Но теперь у этой мечты появился более понятный и эффективный инструмент.